Grokで炎上解析!Xのデマ投稿、その起点を特定へ

Xで激しい炎上やデマが流れてくるたび、こう思いませんか?「この騒動の火種になった、一番最初の投稿って見つけられないの?」って。

もし起点が特定できれば、誰が何のために広めたのか分かり、悪質なデマが燃え広がるのを防げるかもしれないのに…。そんなモヤモヤを抱えていた時、ふと思ったんです。「X社自身が開発したAIのGrokなら、それ、できるんじゃない?」と。この記事では、そんな素朴な疑問をGrokに直接ぶつけてみた結果を、分かりやすく解説します!

コマンドを追記した2026年版の記事はこちらです

はじめに:情報過多の時代に問われる「真実を見抜く力」

X(旧Twitter)は、情報の拡散力が非常に高い一方で、一度デマや誤情報が流れ始めると、瞬く間に社会的な混乱や個人の名誉を傷つける「デジタル・ワイルドファイア(ネット炎上)」を引き起こすプラットフォームです。2025年8月現在も、その脅威は変わりません。

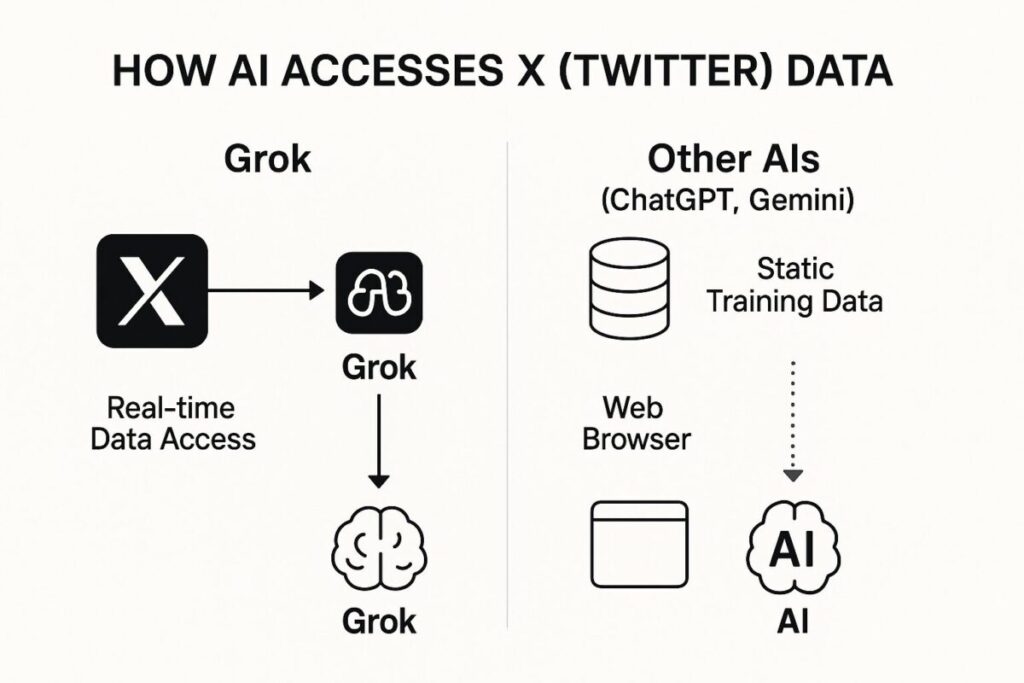

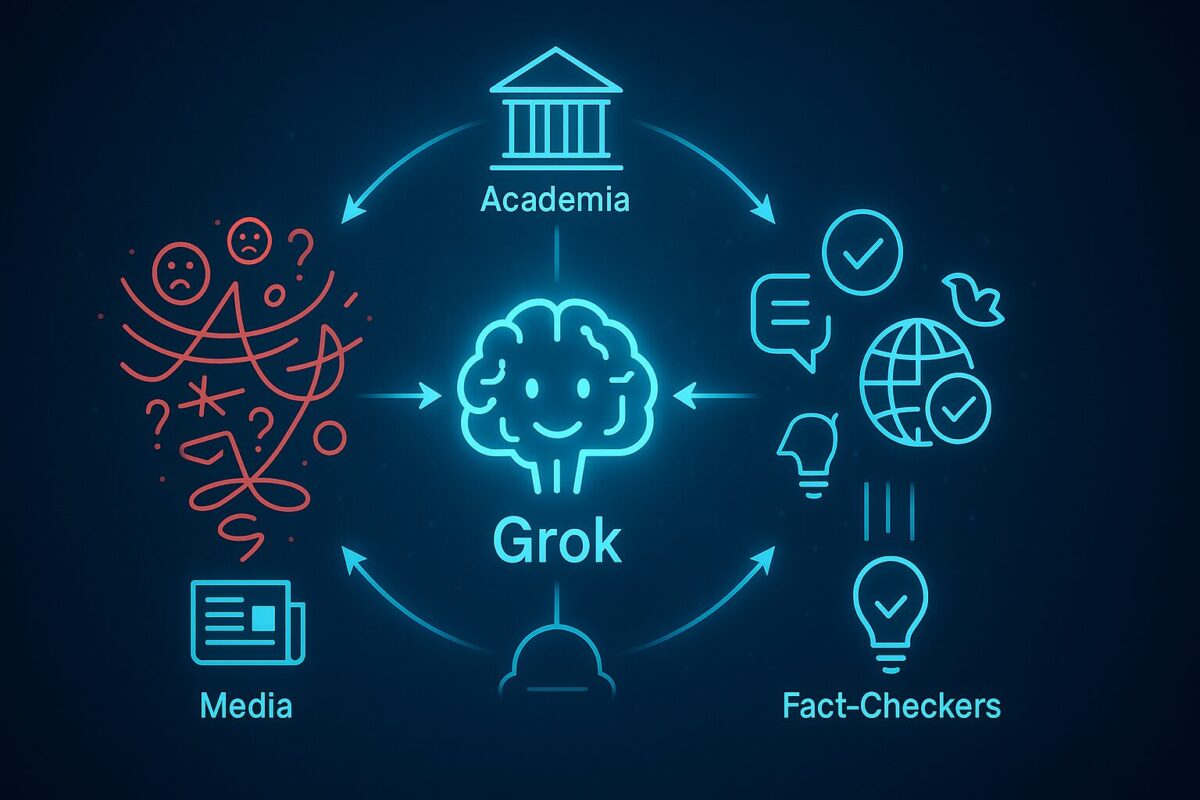

多くの人が利用するChatGPTやGeminiといった生成AIは、膨大な学習データから高精度な文章を生成しますが、X上で「今、まさに」拡散されている情報のリアルタイム追跡には構造的な限界があります。しかし、xAIが開発した「Grok」は、Xプラットフォームとネイティブに統合されており、リアルタイムの公開投稿データにアクセスできるという決定的な違いがあります。

この記事では、Grokが持つそのユニークな能力に着目し、「Xで炎上の火種となった最初の偽情報投稿を、果たして特定できるのか?」という問いを探求します。実際の炎上事例を分析しながら、Grokがもたらす透明性と、私たちが偽情報の拡散に加担せず、炎上を未然に防ぐための実践的な方法を考えていきます。

1. なぜXでは炎上がこれほど速く広がるのか?

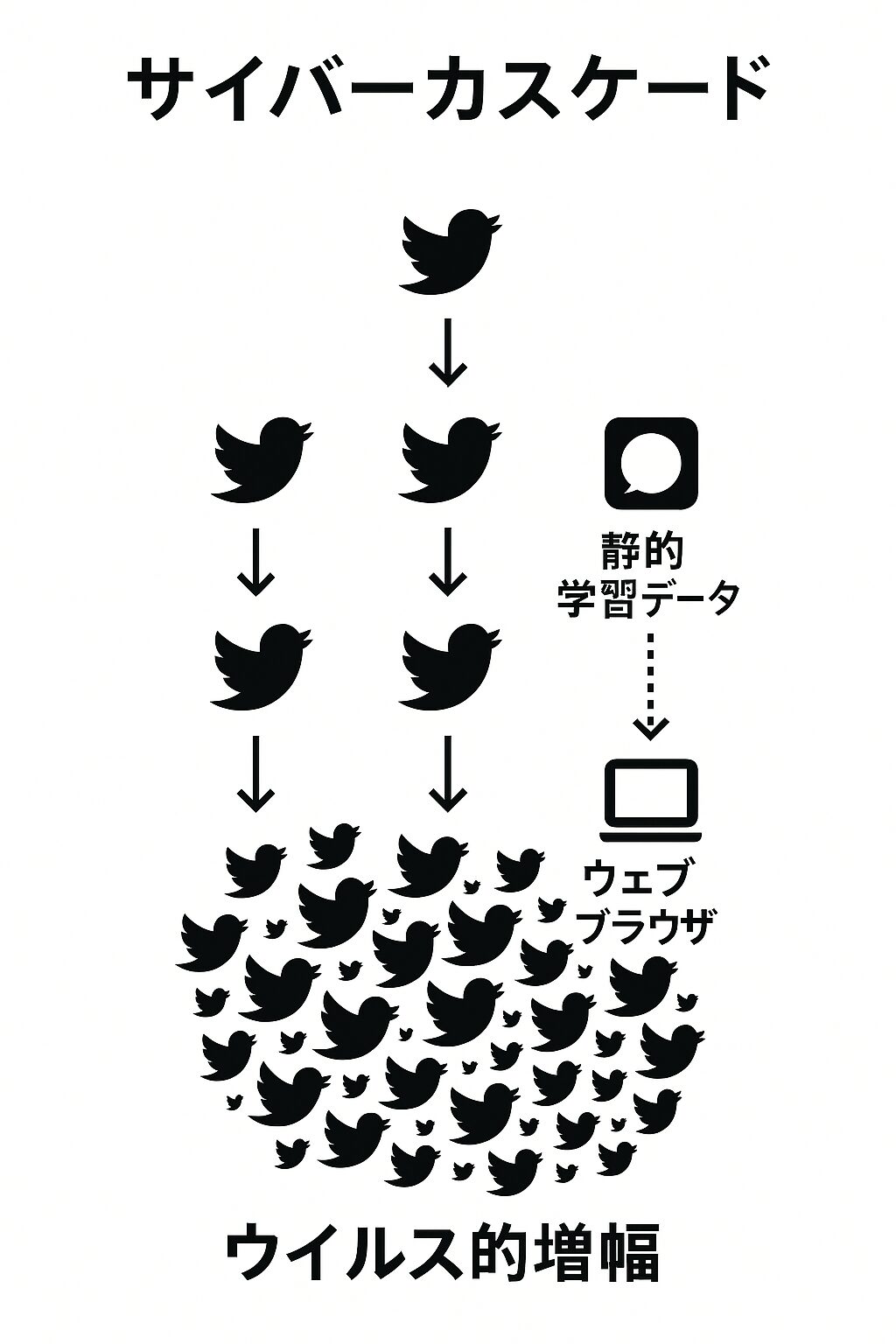

Xにおける炎上のメカニズムは、いくつかの社会的・技術的要因によって加速されます。

- サイバーカスケード現象: 社会心理学者キャス・サンスティーンが指摘するように、閉鎖的なコミュニティ内で特定の見解が反響し合うことで、少数意見があたかも多数派の意見であるかのように増幅され、誤情報が一気に広がる現象です。

- 匿名性と攻撃性: 匿名の衣をまとったアカウントからの無責任な投稿は、人々の攻撃性を助長し、冷静な議論を妨げます。

- 感情をハックするコンテンツ: 「怒り」「驚き」「恐怖」といった強い感情を刺激する投稿は、内容の真偽を確かめる理性的なプロセスを飛び越え、反射的な「いいね」やリツイートを誘発します。

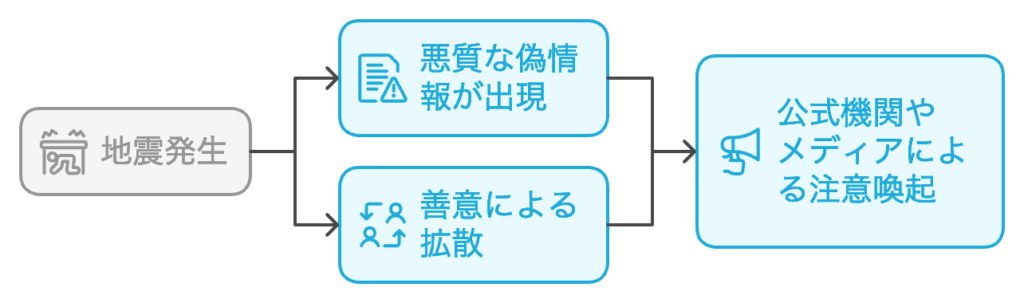

その典型的な例が、2024年1月に発生した能登半島地震の際に拡散された偽情報です。救助を求める投稿を装い、「#救助」「#拡散希望」といったハッシュタグを付けて全く関係のない画像や情報を投稿する悪質なデマが横行しました。 これらの投稿は、人々の善意を利用してインプレッション(表示回数)を稼ぐ目的で行われ、実際の救助活動を妨害する深刻な事態に発展しました。この事例は、炎上の起点を特定し、迅速にファクトチェックを行うことの重要性を浮き彫りにしました。

総務省:災害時における偽・誤情報への対応

- 能登半島地震において、SNSは情報収集手段や安否確認手段として寄与していた一方で、SNS上では、迅速な救命・救助活動や円滑な復旧・復興活動を妨げる*1ような偽・誤情報が流通したと指摘されている。

- URL : https://www.soumu.go.jp/johotsusintokei/whitepaper/ja/r06/pdf/n122000c.pdf

2. Grokの力:他のAIにはない「リアルタイム追跡」の可能性

Grokの最大の武器は、Xの膨大な公開投稿データ(Firehose)にリアルタイムでアクセスできる点にあります。これにより、静的なデータセットや断片的なウェブ検索に頼る他のAIとは一線を画す分析が可能になります。

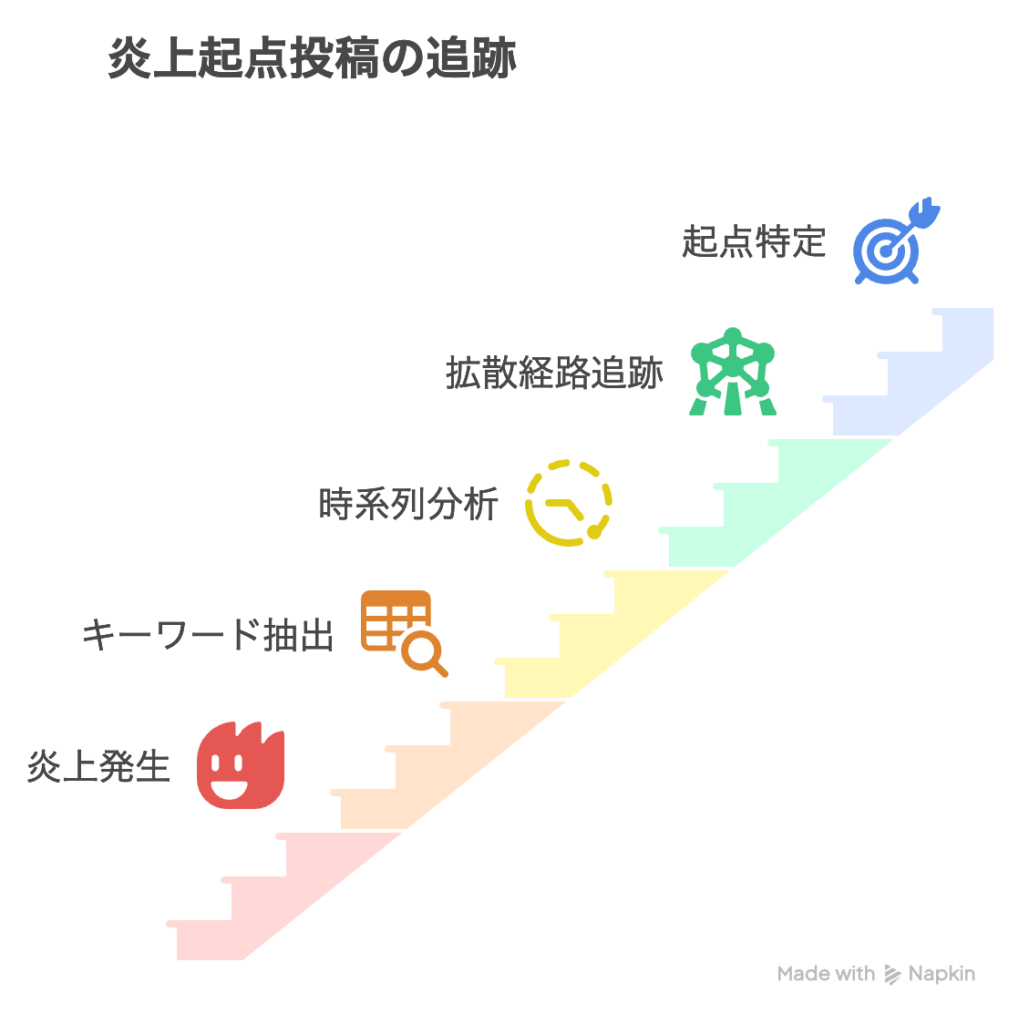

Grokが炎上の起点投稿を特定するプロセスは、以下のように考えられます。

- キーワードと時系列分析: 炎上に関連するキーワードやハッシュタグ(例:「#救助」「#●●(企業名) 不祥事」)を基に、投稿を時系列でソートし、問題の言説が最初に現れた投稿を絞り込みます。

- 引用・リツイートのネットワーク追跡: ある投稿が炎上している場合、その投稿を引用している他のユーザーの投稿群を解析し、拡散のハブとなっているアカウントや、元の情報源を遡って特定します。

- 拡散パターンの異常検知: 通常ではありえない速度でインプレッションやエンゲージメントが急増している投稿を検出し、ボットによる拡散や、意図的な炎上工作の可能性を分析します。

例えば、2024年に大手ビールメーカーのXアカウントが、商品画像に「満20歳未満の者の飲酒は法律で禁じられています」という注意喚起文を記載せずに投稿し、批判が殺到した事例がありました。 このケースでは、起点となった企業の投稿は明確です。しかし、その後「この企業はいつもそうだ」といった過去の事例や、不正確な情報が拡散し始めた場合、Grokならリアルタイムでそれらの派生的な投稿を監視し、どの情報が事実で、どれが憶測やデマなのかを切り分ける手助けができる可能性があります。

ChatGPTやGeminiもウェブ検索機能で関連情報を収集できますが、Xのプラットフォーム上で「誰が、いつ、何を言い始めたか」をμ秒単位で追跡するような動的な分析は、Grokの独壇場と言えるでしょう。

もちろん、Grokも万能ではありません。

- 削除された投稿: 起点となった投稿が削除された場合、Grokがアクセスできるのは公開データに限られるため、直接的な追跡は困難になります。ただし、誰かがスクリーンショットを投稿していれば、その画像を基にした分析は可能です。

- 非公開データ: 鍵アカウント(非公開)の投稿やダイレクトメッセージ(DM)の内容は、分析の対象外です。

- 「嘘」の最終判定: Grokは情報の流れを可視化できますが、その情報が本当に「嘘」かどうかを最終的に判断するのは人間です。信頼できる報道機関や公的機関の情報と照合する「ファクトチェック」のプロセスは不可欠です。

3. 嘘の投稿がもたらす、取り返しのつかないリスク

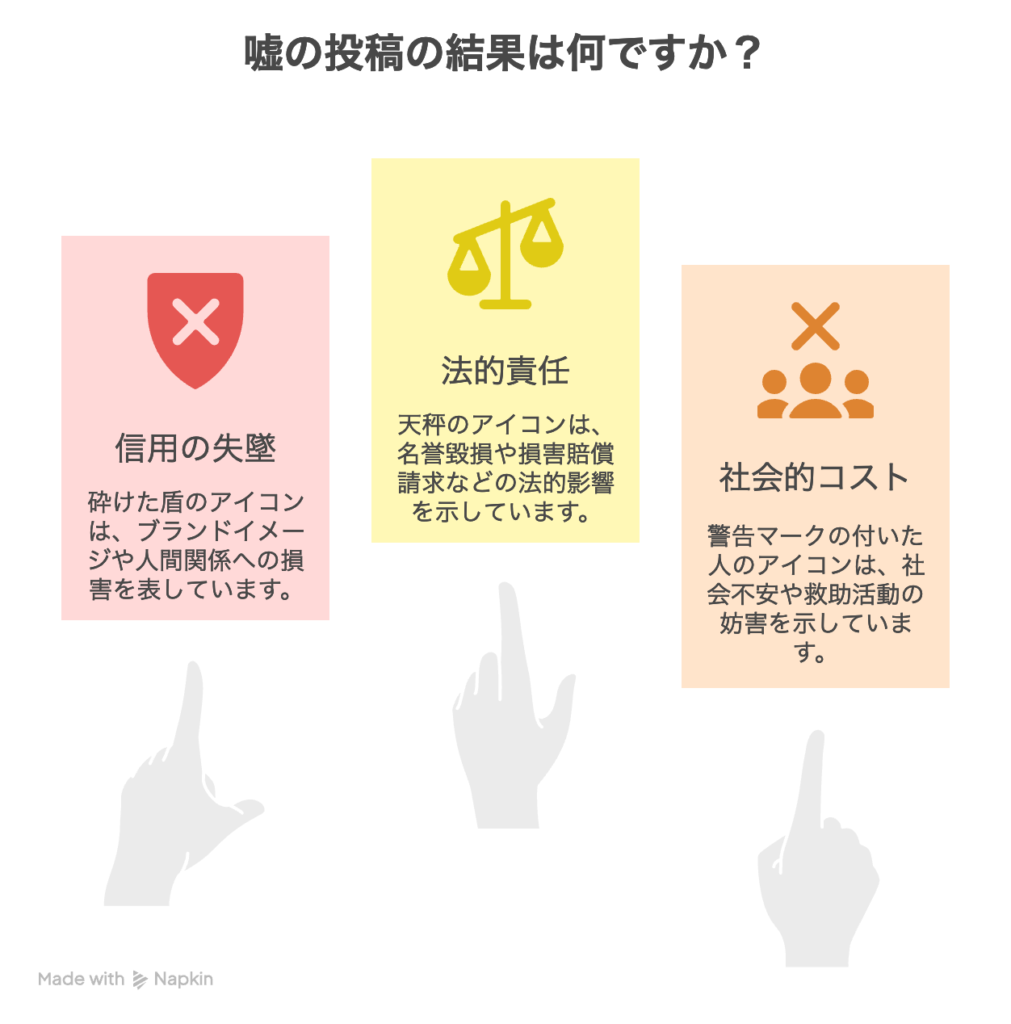

軽い気持ちで投稿した嘘やデマが、個人や企業に与えるダメージは計り知れません。

- 信用の失墜: 一度の不誠実な情報発信が、長年かけて築き上げたブランドイメージや個人の信頼を地に落とすことがあります。

- 法的責任: 内容によっては、名誉毀損や業務妨害として法的な責任を問われるケースも少なくありません。実際に、SNSでの誹謗中傷に対して、発信者情報開示請求を経て損害賠償が命じられる判例は年々増加しています。

- 社会的コスト: 災害時のデマが救助活動を妨げたり、特定の集団への差別を助長したりするなど、社会全体に深刻な悪影響を及ぼします。

Grokのような技術の登場により、発信源の特定が容易になる未来では、「匿名だからバレない」という考えは通用しなくなります。

4. 炎上を減らすために、私たちが今すぐできること

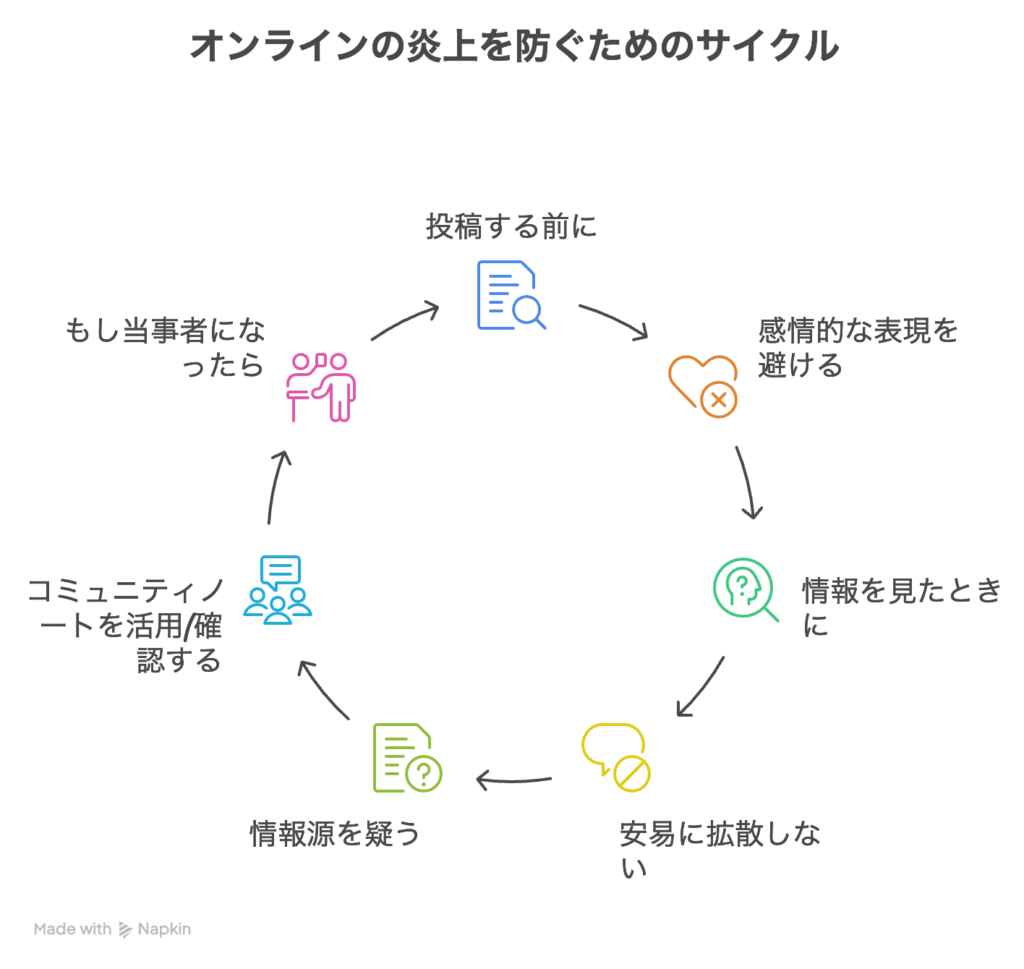

テクノロジーの進化を待つだけでなく、私たちユーザー一人ひとりの行動が、健全な情報空間を作る鍵となります。

- 「一次情報」を疑う習慣: 投稿やニュースに接したとき、その情報源はどこか(公式サイト、信頼できるメディアか)を必ず確認しましょう。特に、感情を煽るような見出しには注意が必要です。

- 「安易な拡散」を避ける: 能登半島地震のデマ拡散では、善意からのリツイートが多く見られました。 不確かな情報に接した際は、「拡散」ではなく「静観」または「通報」が賢明な判断です。

- コミュニティノートの活用: Xには、誤解を招く可能性のある投稿にユーザーが背景情報を追加できる「コミュニティノート」機能があります。この機能を積極的に活用し、集合知によって情報の精度を高めることが期待されます。 Grokの分析とコミュニティノートの知見が組み合わされば、より強力なファクトチェック体制が築けるかもしれません。

- 迅速かつ誠実な対応: 誤った情報を発信してしまった場合、最も重要なのは、迅速に誤りを認め、誠実に謝罪・訂正することです。対応が遅れるほど、炎上の鎮火は困難になります。

5. Grokが描き出すSNSの未来像

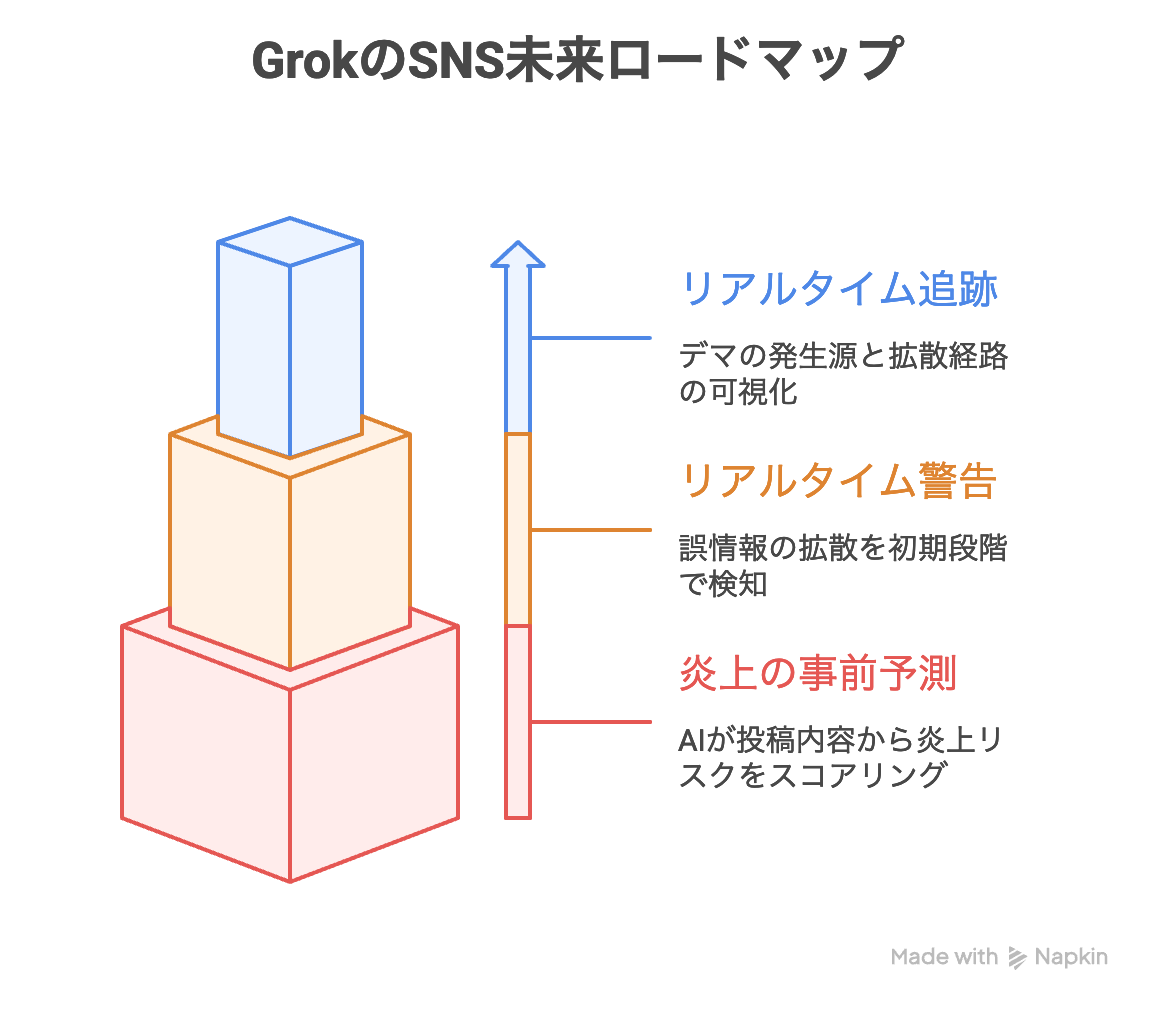

Grokが持つリアルタイム分析能力は、SNSの未来を大きく変えるポテンシャルを秘めています。

- リアルタイム・ファクトチェック: 企業や公的機関がGrokのようなAIを活用し、自組織に関する情報を常時モニタリング。デマが拡散を始める前の段階で検知し、即座に公式見解を発信する未来が考えられます。

- 炎上リスクの事前予測: 過去の膨大な炎上データをAIが学習し、ある投稿が炎上する確率をスコアリングして事前に警告する。そのような機能が実現すれば、表現を再考するきっかけになるでしょう(2025年8月時点でこの機能は未実装です)。

結論:嘘をつくメリットがない時代へ

Xにおける炎上は、一つの嘘や誤解から始まり、社会全体に影響を及ぼします。ChatGPTやGeminiでは追跡が困難だったリアルタイムの情報の流れを、Xと統合されたGrokは可視化し、嘘の起点を暴く力を持っています。

これは、発信者にとって「嘘は隠しきれない」時代の到来を意味します。私たちユーザーは、Grokのようなテクノロジーの特性を理解し、より一層、自らの発言に責任を持たなければなりません。

投稿ボタンを押す前に、一度立ち止まって「この情報は本当に正しいか?」「誰かを傷つけないか?」と自問自答する。その小さな習慣の積み重ねが、炎上を減らし、より健全で信頼できる情報社会を築くための最も確実な一歩となるのです。

コマンドを追記した2026年版の記事はこちらです

![もう嘘はつけない。GrokがXの炎上の火種を見抜く 25 ゼロからはじめる X(旧Twitter) 基本&便利技 [ リンクアップ ]](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/1424/9784297141424_1_3.jpg?_ex=128x128)