モデルが変わっても使い続けられるメタプロンプティング入門

2026年4月下旬、「ChatGPT-5.5とClaude Opus 4.7が同じ日に公式ガイドを公開した。両社のアプローチは完全に正反対だ」という投稿がX(旧Twitter)で数十万インプレッションを記録しました。

この投稿を当事者ではない第三者としてGemini 3.1 ProのDeep Researchで検証してみたところ、そのGeminiの回答自体にも誤りが含まれていました。最終的には公式ドキュメントを自分で読んで確認することになりましたが、この一連の経緯をきっかけに、AIモデルの変化を人間が追いかけ続けることの限界を実感しました。

この記事では、モデルがどう変化しても通用するアプローチとして「各AIモデルに自分向けの最適プロンプトを生成させる方法」を、実際に試せるテンプレートと実践例とともに解説します。

第1章:何が起きていたか──ファクト整理

Xの投稿の真偽(多分?一番拡散された投稿)

Xの自動翻訳により翻訳された投稿

やっとわかったよ、最近なんでみんなが「GPTとClaudeが急にバカになった」って言ってるのかって、 昨日、OpenAIとAnthropicが同時に公式のプロンプトエンジニアリングガイドを公開したんだけど、 それ読んで気づいたんだ。モデルがバカになったわけじゃなくて、 ようやく賢くなって、人間の「考えずに済ませよう」って怠けを許さなくなったんだ

それに一番おもしろいのは、 二つのモデルの進化の方向が、完全に正反対だってこと、 Claude Opus 4.7はどんどん字面通りに解釈するようになって、 前は曖昧な指示を勝手に補完してくれたのに、 今は君が言う通りにやるだけで、一文字も余計に推測しない…続く

| 主張 | 判定 | 実際 |

|---|---|---|

| 両社が「同じ日」にガイド公開 | ❌ | Opus 4.7は4/16、GPT-5.5は4/23。7日差あり |

| Claude Opus 4.7が字義通り解釈に変化 | ✅ | Anthropic公式ドキュメントに明記 |

| ChatGPT-5.5が自律型に変化 | ✅ | OpenAI公式ガイドに明記 |

| 2モデルのアプローチが「完全に正反対」 | ⚠️ | 過度な単純化(後述) |

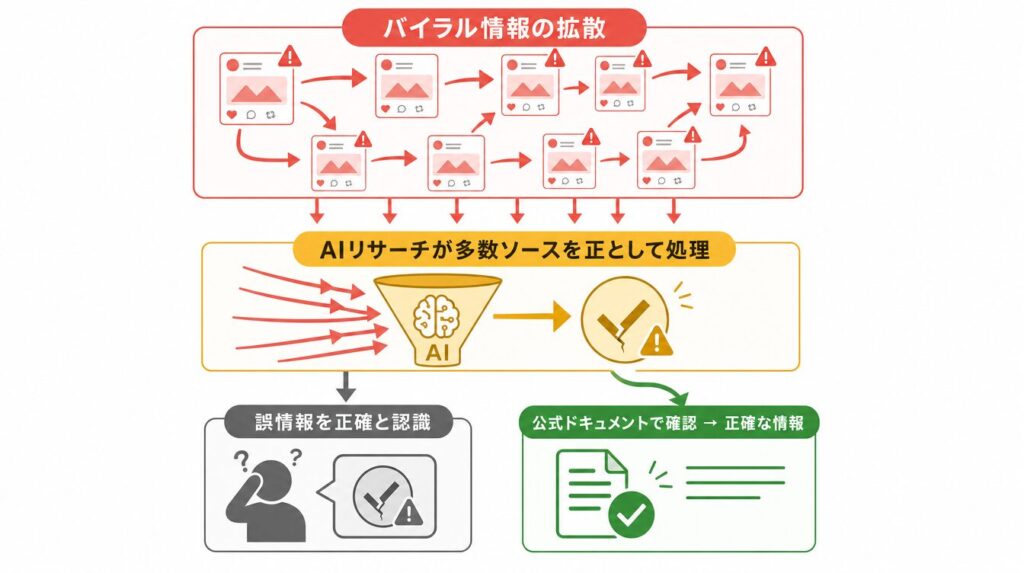

Gemini Deep Researchで起きたこと

第三者検証として「当事者ではないGemini」を選んだのは、Xの投稿がClaude・ChatGPTの話だったためです。方法としては合理的でしたが、Geminiは「同日公開」「完全に正反対」という誤情報をそのまま肯定しました。数十万インプレッションのXの投稿を多数のサイトが引用しており、それが「複数ソースで確認された情報」として処理されたためと考えられます。

さらに私の個人的な感想としてもここ2週間ほどのGeminiの出力に違和感があったため「Gemini 3.1 Pro自身も同様の変化があるか」と聞いたところ、Geminiは冒頭で「ご実感の通りです」と即座に同調しました。「うまくいかない気がする」と前置きすると、AIはその実感を肯定する方向で回答を組み立てやすくなります。Gemini自身に「自分の問題点」を聞くことで客観性が損なわれた形です。

Geminiの回答のうち「字義通り解釈の傾向が強まった」「thinking levelの導入」については公式ドキュメントで確認できました。「3月上旬の完全移行による不安定さ」などは一次情報での裏付けが取れませんでした。

AIリサーチは拡散量が多い情報を優先します。正確さとは別の話です。

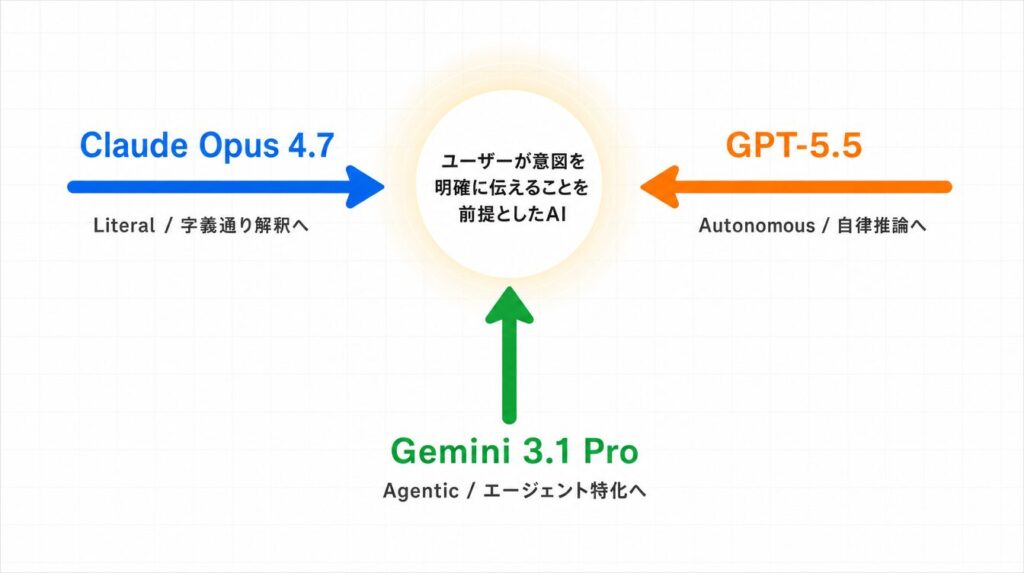

「完全に正反対」が過度な単純化である理由

2モデルの変化を「正反対」と見るのは表面的な解釈です。実際には両社が反対の方向から、同じゴールに向かって収束しています。

- Anthropic(Claude Opus 4.7):「補完しすぎていたモデル」を厳密な指示追従に寄せた

- OpenAI(ChatGPT-5.5):「手取り足取りが必要だったモデル」を自律的な意図推測に寄せた

「干渉しすぎだ(OpenAI)」「説明不足だ(Anthropic)」は出発点が違うだけで、目指す場所は同じです。Gemini 3.1 Proも、thinking levelの導入と「チャット相手ではなく指示対象として扱うべき」という設計方針から、同じ方向に向かっています。

3社ともが「ユーザーが自分の意図を明確に伝えること」を前提としたモデルになっています。

第2章:なぜモデルごとの最適化を追いかけるのは難しいか

Claude Opus 4.7、ChatGPT-5.5、Gemini 3.1 Proのそれぞれに「最適なプロンプトの書き方」があります。ただし、これを人間が覚えて使い分けるアプローチには構造的な問題があります。

更新ペースが速い

Opus 4.7が出たのは4月16日、GPT-5.5は4月23日、Gemini 3.1 Proは2月です。今年だけで3回、「最適なプロンプト術」が変わりました。来月また変わる可能性があります。

使い分けのコストが高い

「これはClaudeに頼む案件だからこの構造で」「これはChatGPTだからゴールだけ伝えよう」と毎回判断するのは、タスクへの集中を妨げます。

モデル自身が一番よく知っている

あるプロンプトがそのモデルにとって最適かどうかを最も正確に判断できるのは、そのモデル自身です。

第3章:普遍的なアプローチ─「AIに自分向けのプロンプトを書かせる」

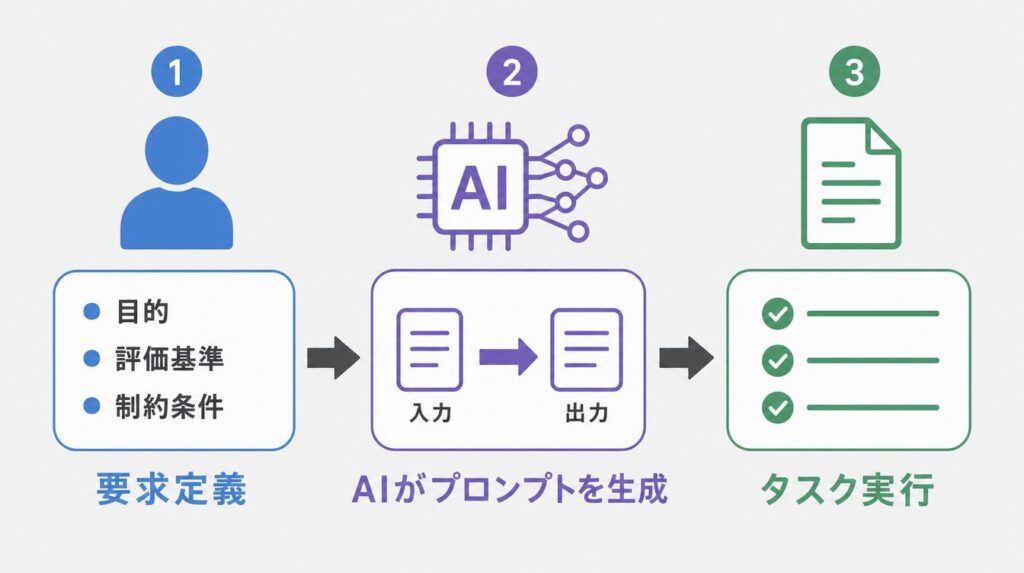

考え方

あなたが用意するのは「何をしたいか(要求定義)」だけです。それを受け取ったAIが、自分が最もうまく動けるプロンプトの形式に変換します。

これを「メタプロンプティング」と呼びます。モデルの性格を人間が理解して最適化するのではなく、そのモデル自身に最適化を任せる方法です。

要求定義として準備する3つのこと

どのモデルを使う場合も、最初に用意するのはこの3点だけです。

- 目的(Why):なぜそれをするのか。誰のため、何のため

- 成功基準(What):どうなっていれば完了とみなすか

- 制約(Not):絶対にやってはいけないこと、含めてほしくないこと

第4章:今日から使えるテンプレートと実践例

基本テンプレート(全モデル共通)

このテンプレートをコピーして、使いたいAI(Claude・ChatGPT・Geminiどれでも)に貼り付けてください。

あなたは優秀なプロンプトエンジニアです。

以下の【要求定義】を読み込み、あなた自身がこのタスクを

最高の精度で実行するための「あなた自身に向けた最適なプロンプト」を作成してください。

作成するプロンプトの条件:

- 曖昧な表現を排除し、条件と成功基準を明確にすること

- 実行のプロセス(How)は細かく指定せず、ゴール(What)と意図(Why)を中心にすること

- 「やってはいけないこと(除外条件)」を必ず含めること

【要求定義】

・目的:[何のために、誰のために行うか]

・ターゲット:[誰に届けるものか、誰が使うものか]

・成功基準:[どうなれば完了とみなすか]

・制約:[絶対に避けるべきこと]

出力は作成したプロンプトのテキストのみを提示してください。実践例1:ブログ記事の執筆依頼

あなたが用意する要求定義

・目的:スマホ買い替えを迷っている30代会社員に、最新iPhoneへの決断を後押ししたい

・ターゲット:IT知識は普通レベル。価格よりも「日常がどう変わるか」を重視する層

・成功基準:読者が「自分の生活のどの不満が解決するか」をイメージできる状態になること

・制約:スペックの数値羅列は最小限に。専門用語は使わない。購入を強要する表現も避けるClaude Opus 4.7が生成したプロンプト例

Claudeは条件・禁止・構成を箇条書きで厳密に定義する形式を選びます。

## タスク

スマートフォンの買い替えを検討中の30代会社員向けに、

最新iPhoneの魅力を伝えるブログ記事を作成する。

## ターゲット読者の定義

- 年齢層:30代・会社員

- ITリテラシー:一般レベル(専門知識不要)

- 購買動機:価格よりも「日常生活の具体的な改善」を重視

## 成功基準

記事を読んだ後、読者が「自分の〇〇という悩みがこの機能で解決する」と

具体的にイメージできる状態。

## 出力構成

1. タイトル(30字以内)

2. リード文(読者の悩みを起点にした100字以内の導入)

3. 見出し3本(それぞれ「日常のどの場面が変わるか」という視点で)

4. 各見出し配下の本文(200字程度)

## 禁止事項

- カメラ画素数・CPU性能などの数値の羅列

- 「最強」「圧倒的」などの根拠のない誇張表現

- 「今すぐ買うべき」など購入を強制する表現

- 専門用語(使用する場合は必ず括弧内で説明を添える)ChatGPT-5.5が生成したプロンプト例

ChatGPTは同じ要求定義でも、ゴールと成功基準をコンパクトにまとめる形式を選びます。

## ゴール

「検討中」の読者を「決断できる状態」に動かす記事を書く。

そのために、この製品が日常のどの不満を解決するかを具体的に見せる。

## 読者像

30代・会社員・ITリテラシーは平均的。

意思決定の軸は「生活がどう変わるか」であり、スペックではない。

## 成功の定義

読者が「自分には〇〇という問題があり、これがそれを解決する」と

言える状態で記事を読み終えること。

## 出力

タイトル+リード+3セクション(それぞれ日常シーン起点)+短い締め。

## 制約

数値の羅列はしない。専門用語は平易な言葉で言い換える。

購入を急かす表現は使わない。同じ要求定義を渡しても、Claudeは仕様書的な詳細定義を、ChatGPTはゴール重視のコンパクトな構成を選びます。それぞれが「自分が動きやすい形式」に変換した結果です。

実践例2:コードのレビュー依頼

あなたが用意する要求定義

・目的:本番環境にデプロイする前のPythonコードの品質確認

・ターゲット:中級エンジニアが書いたコード(自分のコードでもある)

・成功基準:セキュリティ上の問題と、将来的なメンテナンスを難しくする設計の両方を発見できること

・制約:スタイルの細かい指摘は不要。重大度が低い軽微な問題は省略してよいGemini 3.1 Proが生成したプロンプト例

Geminiはアジェンティックなタスク処理に強みがあるため、優先順位と出力フォーマットを明確に定義した形式を選びます。

## レビュー対象の定義

本番デプロイ前のPythonコード。作成者は中級エンジニア。

## レビューの優先順位(高い順)

1. セキュリティリスク(認証・入力検証・機密情報の扱い・依存ライブラリの脆弱性)

2. 長期メンテナンスリスク(密結合・テスト困難な設計・ドキュメント不足)

## 出力フォーマット

各問題について:

- 深刻度:[致命的 / 高 / 中]

- 該当箇所:[行番号または関数名]

- 問題の内容:[1〜2文で説明]

- 修正方針:[具体的なアプローチ]

## 除外事項

- 深刻度「低」の問題(軽微なスタイル・コメントの多寡など)

- PEP 8準拠のチェック実践例3:ユーザーインタビューの分析

あなたが用意する要求定義

・目的:新機能の方向性を決めるための意思決定材料を作りたい

・ターゲット:プロダクトマネージャーと経営層が読む内容

・成功基準:「どの機能に開発リソースを集中させるか」という判断の根拠として使えること

・制約:インタビューに出ていない推測や補完を加えないこと。発言の引用は必ず原文ベースでClaude Opus 4.7が生成したプロンプト例

## タスク

ユーザーインタビューのデータを分析し、プロダクト開発の優先順位判断に使える

構造化されたインサイトレポートを作成する。

## 読者

プロダクトマネージャーおよび経営層

## 成功基準

レポートを読んだ意思決定者が「どの機能に最初にリソースを投入すべきか」を

判断できる状態であること。

## 出力構成

1. エグゼクティブサマリー(3行以内)

2. ユーザーの声から抽出されたニーズ(頻度・重要度でランク付け)

3. 各ニーズを支持するインタビュー発言の抜粋(原文ベース)

4. 機能開発への示唆(推奨順位と根拠)

## 厳守事項

- インタビューデータに存在しない推測・補完・解釈の追加は禁止

- 発言の引用は原文を変えず、必ずどのインタビュー対象者の発言かを明記

- 「ユーザーは〜と感じていると思われる」など推量表現は使用しない第5章:このアプローチが長く使い続けられる理由

モデルが変わっても使える

来月Claude Opus 4.8が出ても、ChatGPT-5.6が出ても、要求定義を渡せばそのモデルが「その時点での自分向けの最適プロンプト」を生成します。モデルの最新プロンプト術を追いかける手間が減ります。

複数モデルを比較しやすくなる

同じ要求定義を複数のモデルに投げることで、どのモデルがそのタスクに向いているかを確かめやすくなります。モデルが変換したプロンプトの形式の違いを見るだけで、各モデルの設計方針の違いも自然に把握できます。

AIへの指示以外にも使える

目的・成功基準・制約を言語化する習慣は、AIへの指示に限りません。チームへの依頼、企画書、提案書、発注書など、意図を伝えるあらゆる場面で同じ考え方が使えます。

第6章:AIリサーチの使い方─今回の経験から

AIリサーチの3つの弱点

| 弱点 | 内容 |

|---|---|

| 拡散量バイアス | 多くのサイトで言及されている情報を「確認された情報」として扱うため、バイラルな誤情報が正確に見えやすい |

| 確証バイアス | 「〇〇な気がする」と前置きすると、その実感を肯定する方向で回答を組み立てやすい |

| 自己申告バイアス | AIに自身の問題点を聞くと客観性が保てない |

AIリサーチを使うときの流れ

- AIリサーチで仮説と論点を整理する(速い・広い)

- 気になる主張は公式ドキュメントで確認する(正確)

- 「自分の実感を肯定しているだけでは?」と自問する(バイアス除去)

今回の検証で最終的に有効だったのは、anthropic.com・openai.com・ai.google.devの公式ドキュメントを直接読むステップでした。AIリサーチは「どこを読めばいいかを教えてくれるナビゲーター」として使い、判断の根拠は一次情報で確認するという使い分けが有効です。

まとめ

今回の一連の出来事を振り返ると、AIが退化したわけでも劣化したわけでもありませんでした。Claude・ChatGPT・Geminiの3社ともが「ユーザーが自分の意図を明確に伝えることを前提とした設計」に向かっていました。

モデルが変わるたびにプロンプトを覚え直す手間は、メタプロンプティングの考え方を取り入れることで少しずつ減らせます。

次にAIに何かを頼む前に、3点だけ書いてみてください。

- 目的は何か

- 成功した状態はどういう状態か

- 絶対にやってほしくないことは何か

この3点を用意したら、そのままAIに渡して「あなたに向けた最適なプロンプトを作ってください」と頼んでみてください。

今回の記事は、Xでたまたま目にしたバズり投稿がきっかけでした。ただ、AIにプロンプト作成を任せられるようになったからといって、プロンプティングの学習が不要になるわけではありません。プログラミングと同じで、生成されたプロンプト(コード)を読み解き、意図通りかどうかを判断する知識は必要です。AIはあくまで補助輪であり、最終的な品質の判断は人間が行います。メタプロンプティングは「考える手間をゼロにする魔法」ではなく、「考える方向を正しく向けるための道具」として使うのが正解です。

更新履歴

- 2026-05-02:初版公開

参考:公式一次情報

- Anthropic Claude Opus 4.7 リリースノート:

anthropic.com/news/claude-opus-4-7 - Anthropic プロンプトガイド:

platform.claude.com/docs/en/build-with-claude/prompt-engineering - OpenAI GPT-5.5 リリース:

openai.com/index/introducing-gpt-5-5/ - OpenAI GPT-5.5 プロンプトガイド:

developers.openai.com/api/docs/guides/prompt-guidance - Google Gemini 3.1 Pro:

blog.google/innovation-and-ai/models-and-research/gemini-models/gemini-3-1-pro/ - Google Gemini プロンプト設計:

ai.google.dev/gemini-api/docs/prompting-strategies

![AIにプロンプトを作らせる方法──Claude・ChatGPT・Gemini対応 22 ChatGPTを使い尽くす! 深津式プロンプト読本 [ 深津 貴之 ]](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/0930/9784296070930.jpg?_ex=128x128)